ตอนที่ 11: ศาสตร์แห่งความจุ (Areal Density) สมการทะลุขีดจำกัดที่วิศวกร HDD ต้องสยบ

1. 🎯 ตอนที่ 11: ศาสตร์แห่งความจุ (Areal Density) สมการทะลุขีดจำกัดที่วิศวกร HDD ต้องสยบ

2. 📖 เปิดฉาก (The Hook)

สวัสดีน้องๆ วิศวกร R&D และสายเมคคาทรอนิกส์ทุกคนครับ! กลับมาพบกันอีกครั้งกับซีรีส์ เจาะลึกวิศวกรรมเบื้องหลังอุตสาหกรรมฮาร์ดดิสก์ไดรฟ์

น้องๆ เคยสงสัยไหมครับว่า ฮาร์ดดิสก์ไดรฟ์ตัวแรกของโลกอย่าง IBM RAMAC ในปี 1956 ซึ่งมีขนาดใหญ่เท่าตู้เย็นและใช้แผ่นจานแม่เหล็กขนาด 24 นิ้วถึง 50 แผ่น ดันเก็บข้อมูลได้แค่ 5 เมกะไบต์ (MB) แต่ทำไมฮาร์ดดิสก์ขนาด 3.5 นิ้วในมือพวกเราวันนี้ถึงเก็บข้อมูลได้มหาศาลระดับหลายสิบเทราไบต์ (TB)?

คำตอบของความมหัศจรรย์นี้สรุปได้ในคำสั้นๆ เพียงคำเดียวคือ “Areal Density” (ความหนาแน่นเชิงพื้นที่) ครับ! ในวงการเซมิคอนดักเตอร์เขามี “กฎของมัวร์ (Moore’s Law)” ที่ว่าจำนวนทรานซิสเตอร์จะเพิ่มขึ้น 2 เท่าทุกๆ 18 เดือน วงการ HDD ของพวกเราก็มีอัตราการเติบโตของ Areal Density ที่ดุเดือดไม่แพ้กัน (บางช่วงโตถึง 60-100% ต่อปีด้วยซ้ำ!) วันนี้พี่จะพาน้องๆ ไปเจาะลึกสมการและศาสตร์แห่งความจุ ที่เป็นเหมือน “เป้าหมายสูงสุด (Holy Grail)” ของวิศวกรโรงงานฮาร์ดดิสก์ทั่วโลกกันครับ!

3. 🧠 แก่นวิชาวิศวกรรม (Core Concepts)

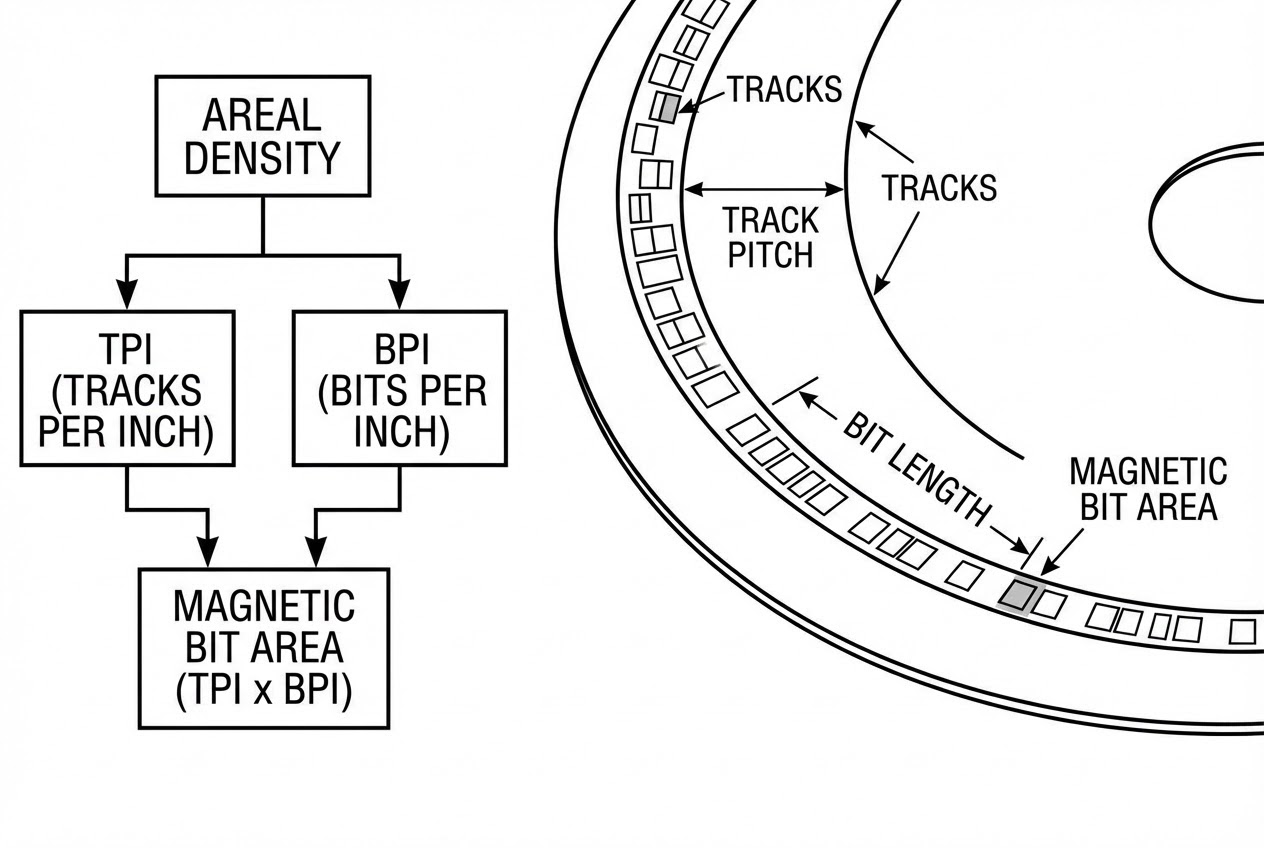

คำว่า Areal Density หรือความหนาแน่นเชิงพื้นที่ คือ “จำนวนบิตข้อมูล (Bits) ที่เราสามารถยัดลงไปได้ในพื้นที่ 1 ตารางนิ้วบนแผ่นดิสก์” โดยมีหน่วยเป็น Bits per square inch ($bits/in^2$) หรือในยุคนี้เราจะคุ้นกับหน่วย $Gbits/in^2$ (กิกะบิตต่อตารางนิ้ว) ไปจนถึง $Tbits/in^2$ แล้วครับ

เปรียบเทียบให้เห็นภาพง่ายๆ เหมือนน้องเป็นผู้ว่าผู้ดูแลผังเมือง น้องมีพื้นที่จำกัด (ขนาดแผ่นดิสก์ 3.5 นิ้ว) ถ้าน้องอยากให้มีคนเข้ามาอยู่เยอะๆ (ความจุเยอะขึ้น) น้องต้องทำ 2 อย่าง คือ:

- บีบความกว้างของถนนให้แคบลง: ในฮาร์ดดิสก์เราเรียกว่าการเพิ่ม Track Density (TPI - Tracks Per Inch) คือการอัดจำนวนลู่วิ่ง (Tracks) ลงในแนวรัศมีให้ได้มากที่สุด

- บีบขนาดบ้านแต่ละหลังให้เล็กลงแล้วสร้างติดกัน: ในฮาร์ดดิสก์เราเรียกว่าการเพิ่ม Linear Density หรือ Bit Density (BPI - Bits Per Inch) คือการอัดจำนวนบิตข้อมูลลงไปตามความยาวของแต่ละลู่วิ่งให้แน่นที่สุด

ทำไม Areal Density ถึงเป็นเป้าหมายสูงสุด?

- ความจุและต้นทุน: ยิ่งความหนาแน่นสูง เราก็จะได้ฮาร์ดดิสก์ที่ความจุสูงขึ้นในขนาดฟอร์มแฟคเตอร์เท่าเดิม (หรือเล็กลง) ส่งผลให้ต้นทุนต่อกิกะไบต์ (Cost/GB) ลดลงมหาศาล

- ความเร็ว (Performance): บิตที่อยู่ชิดกันมากขึ้น แปลว่าหัวอ่านที่บินด้วยความเร็วเท่าเดิม จะกวาดข้อมูลได้ “จำนวนบิตต่อวินาที” มากขึ้น (Data Transfer Rate สูงขึ้น) และหัวอ่านก็ไม่ต้องขยับแขนไกลนักเพื่อหาข้อมูล (ลดระยะ Seek Time)

4. 🧮 ร่ายมนต์สมการและลอจิกการทำงาน (The Math & Logic)

ในมุมของฟิสิกส์และคณิตศาสตร์ เราสามารถคำนวณ Areal Density ได้ง่ายๆ จากผลคูณของความหนาแน่นทั้งสองแกนที่เราเพิ่งพูดถึงไปครับ

ให้ $L_{bit}$ คือ ความยาวของบิตข้อมูลหนึ่งตัว (Bit length) ให้ $W_{trk}$ คือ ความกว้างของแทร็ก หรือระยะห่างระหว่างศูนย์กลางแทร็ก (Track pitch) พื้นที่ของข้อมูล 1 บิต ($A_{bit}$) จะเท่ากับ: $$ A_{bit} = L_{bit} \times W_{trk} $$

ดังนั้น ความหนาแน่นเชิงเส้น (Linear Density: $D_l$) และ ความหนาแน่นของแทร็ก (Track Density: $D_t$) จะเป็นส่วนกลับของระยะเหล่านี้: $$ D_l = \frac{1}{L_{bit}} \text{ (หน่วยเป็น BPI)} $$ $$ D_t = \frac{1}{W_{trk}} \text{ (หน่วยเป็น TPI)} $$

และสมการแห่งความจุ Areal Density ($D_a$) ก็คือ: $$ D_a = D_l \times D_t $$

อธิบายภาษาคนสไตล์รุ่นพี่: สมมติว่าวิศวกรสั่งให้เพิ่มความจุฮาร์ดดิสก์เป็น 2 เท่า น้องมีทางเลือกคือ จะเบิ้ล $D_l$ หรือจะเบิ้ล $D_t$ หรือจะเพิ่มทั้งคู่แต่อย่างละนิดหน่อย? ในความเป็นจริงเราเพิ่มด้านใดด้านหนึ่งแบบก้าวกระโดดไม่ได้ครับ เพราะถ้าบีบ $W_{trk}$ แคบไป (เพิ่ม TPI) หัวอ่านก็จะไปอ่านกวนแทร็กข้างๆ และถ้าบีบ $L_{bit}$ เล็กไป (เพิ่ม BPI) สัญญาณแม่เหล็กแต่ละบิตก็จะอ่อนแรงลงจนกวนกันเอง วิศวกรจึงต้องพยายามปรับสัดส่วนระหว่าง $D_l$ และ $D_t$ ที่เราเรียกว่า Bit Aspect Ratio (BAR) ให้อยู่ในจุดที่สมดุลที่สุดเสมอ (เช่น 4:1 หรือ 8:1)

5. 🛡️ เคล็ดลับคนหน้างาน (Factory Floor Pro-Tips)

เมื่อน้องๆ ต้องมาทำงานหน้าไลน์ผลิต หรือเข้าห้องแล็บออกแบบ สิ่งที่ตามมาจากการดัน Areal Density ให้สูงขึ้น คือ “ปีศาจ” 2 ตัวที่น้องต้องสู้รบด้วยครับ:

ขีดจำกัดด้านงบประมาณความแม่นยำ (TMR Budget): เมื่อเราดัน Track Density (TPI) ให้สูงขึ้น แทร็กจะแคบลงมาก กฎเหล็กของระบบ Servo คือ “หัวอ่านต้องห้ามเบี่ยงเบนออกจากศูนย์กลางแทร็กเกิน 10% ของความกว้างแทร็ก (Track Pitch)” (เราเรียกค่านี้ว่า Track Misregistration หรือ TMR) ลองคิดดูนะ ถ้าน้องทำไดรฟ์ที่ 100,000 TPI ความกว้างแทร็กจะอยู่ที่ประมาณ 10 ไมโครนิ้ว… แปลว่าระบบ Servo ของน้องห้ามแกว่งเกิน 1 ไมโครนิ้ว (หรือประมาณ 25 นาโนเมตร)! ถ้ามีลมกระพือ (Windage) หรือตลับลูกปืนแกว่ง (NRRO) แม้แต่นิดเดียว ข้อมูลพังทันที! นี่คือเหตุผลที่เราต้องมี Microactuator หรือระบบควบคุมแบบ Dual/Triple-Stage เข้ามาช่วยไงล่ะครับ

ขีดจำกัดความเสถียรทางความร้อน (Superparamagnetic Limit): ในฝั่งของการเพิ่ม Linear Density (BPI) เมื่อเราบีบบิตข้อมูลให้เล็กมากๆ เพื่อให้สัญญาณรบกวนต่ำ (SNR สูงกว่า 20 dB) หนึ่งบิตข้อมูลควรจะมีเม็ดเกรนแม่เหล็กประมาณ 100 เม็ด แต่พอเราทำเกรนให้เล็กจิ๋วเกินไป พลังงานความร้อนในอุณหภูมิห้องปกติ ($k_B T$) ก็จะมากพอที่จะทำให้ “ขั้วแม่เหล็กสลับด้านไปมาเองได้” ข้อมูลลูกค้าจึงอันตรธานหายไปในอากาศ! ปรากฏการณ์นี้เรียกว่า Superparamagnetic Effect ซึ่งเป็นกำแพงทางฟิสิกส์ที่น่ากลัวที่สุดของวงการ

6. 🏁 บทสรุป (To be continued…)

เป็นยังไงบ้างครับน้องๆ Areal Density หรือศาสตร์แห่งความจุ ไม่ใช่แค่การเอาตัวเลขมาคูณกันง่ายๆ แต่คือการต่อสู้ระหว่าง วิศวกรรมระบบควบคุม (Servo) เพื่อเอาชนะระยะห่างระดับนาโนเมตร และ วิศวกรรมวัสดุศาสตร์ (Media & Heads) เพื่อเอาชนะกฎฟิสิกส์ของแม่เหล็ก

และอย่างที่พี่ทิ้งท้ายไว้ในข้อ 2… เมื่อเราเดินมาชนกำแพงของ Superparamagnetic Limit ที่อนุภาคแม่เหล็กมันเล็กจนรักษาข้อมูลไว้ไม่ได้แล้ว วิศวกร HDD จะมีทางออกอื่นอีกไหม? ในตอนหน้า พี่จะพาน้องๆ ไปพบกับสุดยอดนวัตกรรมกู้ชีพอย่าง HAMR (Heat-Assisted Magnetic Recording) ที่ต้องใช้ “แสงเลเซอร์” มาช่วยในการเขียนข้อมูล! เตรียมตัวให้พร้อม แล้วพบกันครับ!

ต้องการที่ปรึกษาด้านการออกแบบระบบ Automation, Machine Vision หรือระบบควบคุมความแม่นยำสูงให้กับโรงงานของคุณ? ทีมงาน WP Solution พร้อมให้บริการออกแบบและติดตั้งระบบแบบครบวงจร ดูรายละเอียดบริการของเราได้ที่: www.wpsolution2017.com หรือพูดคุยปรึกษาเบื้องต้นได้ที่ Line: wisit.p