ตอนที่ 15: สรุปเส้นทาง Phase 1 และเตรียมเปิดฝากระโปรงเครื่องยนต์สู่ Phase 2

1. 🎯 ตอนที่ 15: สรุปเส้นทาง Phase 1 และเตรียมตัวสู่การเจาะลึกกลไก

สวัสดีครับน้องๆ วิศวกรสาย Vision และนักพัฒนา AI ทุกท่าน! ยกแก้วกาแฟขึ้นมาฉลองความสำเร็จกันหน่อยครับ!

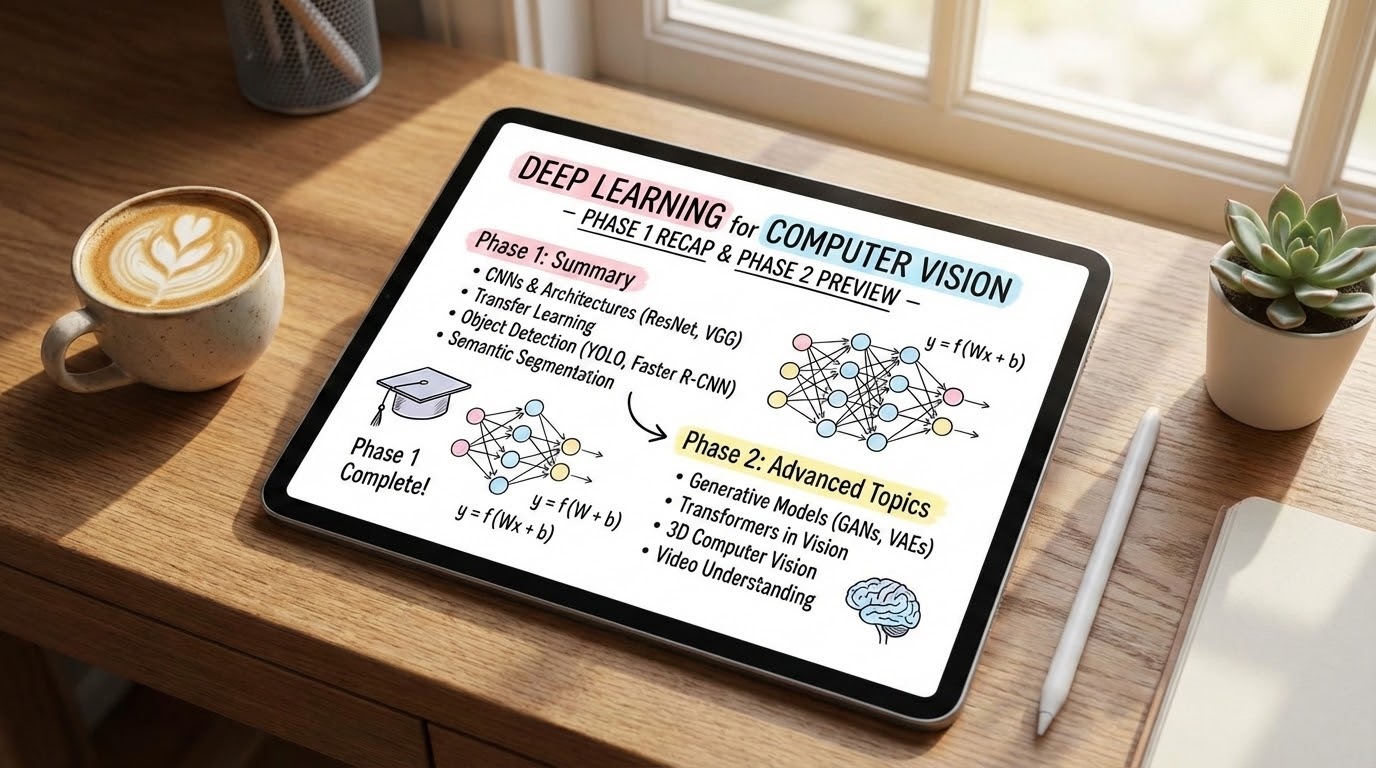

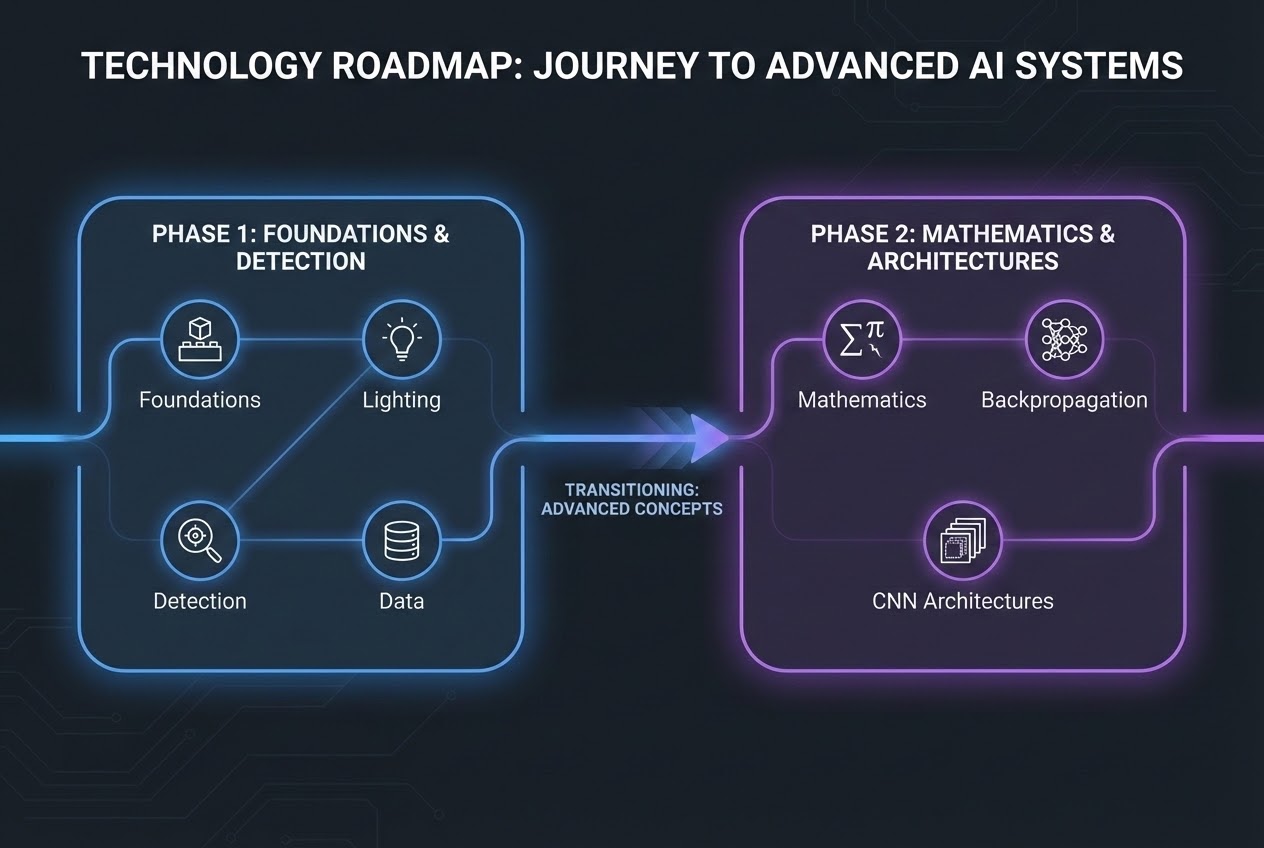

เราเดินทางกันมาถึงตอนที่ 15 แล้ว ถือเป็นการจบ “Phase 1: ปูพื้นฐานดวงตาจักรกล” อย่างเป็นทางการครับ ตลอด 14 ตอนที่ผ่านมา พี่ได้พาน้องๆ นั่งไทม์แมชชีนจากยุคของการเขียนโค้ดแบบ Rule-based งมหาพิกเซลด้วยมือ (Traditional Computer Vision) จนมาถึงยุคที่ AI สามารถเรียนรู้และสกัดจุดเด่น (Feature Extraction) ได้ด้วยตัวเองผ่าน Deep Learning

วันนี้เราจะมาทบทวนความจำ (Recap) เพื่อรวบรวมจิ๊กซอว์ทุกชิ้นให้เห็นเป็นภาพใหญ่ภาพเดียวกัน ก่อนที่เราจะเตรียมตัว “เปิดฝากระโปรงรถ” เพื่อเจาะลึกไปดูฟันเฟืองและคณิตศาสตร์ที่ซ่อนอยู่เบื้องหลังใน Phase 2 กันครับ!

2. 📖 เปิดฉาก (The Hook)

ในโลกของการทำงานจริง ถ้าน้องรู้แค่ว่า “จะเรียกใช้ไลบรารีอย่างไร” (ใช้ Keras สั่ง model.fit()) น้องก็เปรียบเสมือน “คนขับรถ” ครับ ซึ่งขับเป็น ขับเก่ง แต่พอวันหนึ่งรถเกิดเสีย ยางแตก หรือเครื่องยนต์มีเสียงแปลกๆ (เช่น โมเดลเกิด Overfitting, Loss ไม่ยอมลด, หรือเจอ Data Bias) คนขับรถจะทำอะไรไม่ได้เลยนอกจากยืนงง

แต่เป้าหมายของซีรีส์นี้คือการปั้นน้องๆ ให้เป็น “วิศวกรผู้สร้างและซ่อมเครื่องยนต์ AI” ครับ! ใน Phase 1 เราได้เรียนรู้วิธีการขับรถ กฎจราจร และการจัดเตรียมสภาพแวดล้อมไปแล้ว เพื่อเตรียมความพร้อมให้ทุกคนมีภาษากลาง (Common vocabulary) ที่ตรงกัน ก่อนที่เราจะมุดลงไปดูสมการ Backpropagation และสถาปัตยกรรมระดับลึกใน Phase 2 ครับ เรามาทบทวนกันว่าในกระเป๋าเครื่องมือของเราตอนนี้มีอะไรอยู่บ้าง!

3. 🧠 แก่นวิชา (Core Concepts)

ลองหลับตาแล้วนึกตามพี่นะครับ นี่คือ 4 เสาหลักของวิชา Machine Vision ที่เราได้เรียนรู้กันไปใน Phase 1:

- เสาหลักที่ 1: จากแสงสู่ตัวเลข (Hardware & Lighting)

- เราเรียนรู้ว่า “แสง” สำคัญกว่าโค้ด! การจัดแสงแบบ Dome, Dark Field หรือ Backlight คือการแก้ปัญหาที่ต้นเหตุเพื่อเพิ่ม Signal-to-Noise Ratio (SNR) ให้สูงที่สุด

- เราเข้าใจว่าคอมพิวเตอร์มองเห็นภาพเป็นเพียงตารางตัวเลข (Tensor)

- เรามีอาวุธหนักอย่าง NVIDIA GPU และสถาปัตยกรรม CUDA/cuDNN ที่คอยขับเคลื่อน Frameworks ระดับโลกอย่าง TensorFlow และ PyTorch

- เสาหลักที่ 2: งาน 4 ระดับของ Computer Vision (The 4 Tasks)

- Image Classification: AI ทายว่า “ในภาพมีอะไร” (เช่น หมา หรือ แมว)

- Object Detection: AI หากล่อง Bounding Box เพื่อบอกว่า “สิ่งนั้นอยู่พิกัด (x, y, w, h) ไหน”

- Image Segmentation: AI ระบายสีแยกระดับ “พิกเซล” (Semantic เหมาเข่ง, Instance แยกรายตัว) เพื่อทะลวงขีดจำกัดของกรอบสี่เหลี่ยม

- Object Tracking: AI จำหน้าวัตถุข้ามเฟรมวิดีโอ (Data Association) ด้วยค่า IoU เพื่อวิเคราะห์การเคลื่อนที่

- เสาหลักที่ 3: คัมภีร์คำศัพท์ (The Cheat Sheet)

- เราไม่กลัวคำศัพท์เอเลี่ยนอีกต่อไป! เรารู้จัก Dataset (หนังสือเรียน), Epoch (จำนวนรอบที่อ่านจบเล่ม), Batch Size (จำนวนรูปที่อ่านรวดเดียว), Weights (ความสำคัญ) และ Biases (ความเอนเอียง)

- เสาหลักที่ 4: ข้อมูลคือหัวใจ (Data is the King)

- Deep Learning เป็นสัตว์ประหลาดที่หิวข้อมูล เราได้รู้จัก Public Datasets อย่าง ImageNet และ MS COCO

- เราเรียนรู้วิธีทำ Data Annotation ด้วยการตีกรอบและระบายสี (LabelImg/LabelMe)

- และที่สำคัญที่สุด เราตระหนักถึงความน่ากลัวของ Data Bias (ความลำเอียงของข้อมูล) ที่อาจทำให้โมเดลของเราตาบอดเมื่อลงหน้างานจริง!

4. 💻 ร่ายมนต์โค้ด (Show me the Code)

เพื่อเป็นการสรุปภาพรวม (End-to-End Pipeline) ของ Phase 1 นี่คือ Pseudo-code สไตล์ Python ที่รวมทุกคอนเซปต์ที่เราเรียนมาไว้ในที่เดียวครับ:

# ---------------------------------------------------------

# 📌 สรุป Pipeline ของ Computer Vision ใน Phase 1

# ---------------------------------------------------------

import tensorflow as tf

from vision_library import Camera, Lighting, DataAnnotator

# 1. Hardware & Lighting: ถ่ายภาพชิ้นงานด้วยแสงที่เหมาะสม (เช่น Backlight หาขอบ)

camera = Camera(lighting='Diffuse Backlight')

raw_image = camera.capture_image()

# 2. Data Preparation: โหลด Dataset ที่ผ่านการทำ Annotation มาแล้ว และไม่มี Bias

dataset = load_dataset('factory_parts_unbiased')

X_train, y_train_boxes = dataset.get_tensors() # แปลงภาพและ Bounding Box เป็น Tensor

# 3. Model Architecture: เลือกประเภทของงาน (เช่น Object Detection)

# เตรียมส่งต่อให้ GPU ประมวลผลผ่าน Framework

model = tf.keras.models.load_model('YOLO_Object_Detector')

# 4. Training (การเรียนรู้): กำหนด Hyperparameters

# AI จะปรับ Weights และ Biases ซ้ำๆ จนกว่าจะทายแม่น

model.fit(X_train, y_train_boxes, batch_size=32, epochs=50)

# 5. Inference (การนำไปใช้งานจริง): ส่งพิกัดให้หุ่นยนต์

predictions = model.predict(raw_image)

print(f"พบชิ้นงานเสียที่พิกัด: {predictions['bounding_boxes']}")คอมเมนต์สไตล์วิศวกรรุ่นพี่: ใน Phase 1 เรามองบรรทัด model.fit() และโครงสร้างของ model เป็นแค่ “กล่องดำ (Black-box)” ที่โยนข้อมูลเข้าไปแล้วได้ความฉลาดออกมา แต่ใน Phase 2 เราจะมาผ่ากล่องดำนี้ดูไส้ในกันครับ!

5. 🛡️ เคล็ดลับจากคัมภีร์ลับ (Under the Hood / Pro-Tips)

ทำไมเราถึงต้องไปเรียนคณิตศาสตร์และโครงสร้างสถาปัตยกรรมเครือข่ายต่อใน Phase 2? พี่มีเหตุผลจากหน้างานจริงมาบอกครับ:

- เมื่อ Loss ไม่ลด (The Vanishing Gradient): เวลาเทรนโมเดลลึกๆ (Deep Networks) น้องอาจจะเจออาการที่ค่าความผิดพลาด (Loss) ไม่ยอมลดลงเลยตั้งแต่ Epoch แรกๆ ถ้าน้องไม่เข้าใจคณิตศาสตร์ของฟังก์ชันกระตุ้น (Activation Function เช่น Sigmoid vs ReLU) และการไหลย้อนกลับของความผิดพลาด (Backpropagation) น้องจะไม่รู้เลยว่าสมองของ AI มัน “ตาย” ไปแล้วและต้องแก้โค้ดตรงไหน!

- ออกแบบ Network ให้เข้ากับ Hardware (Resource Constraints): ถ้าน้องไปรับงานที่ต้องเอากล้อง AI ไปติดบนโดรนตัวเล็กๆ (Edge Computing) แรมมันมีจำกัดมากครับ! น้องไม่สามารถเอาโมเดลยักษ์อย่าง VGG-16 ไปรันได้ น้องต้องมีความรู้เรื่องสถาปัตยกรรมเพื่อออกแบบโมเดลสายซิ่ง หรือใช้เทคนิครีดน้ำหนัก (Model Optimization/Quantization) ให้มันเล็กลงแต่ยังฉลาดเท่าเดิมครับ

6. 🏁 บทสรุป (To be continued…)

ขอแสดงความยินดีกับน้องๆ ทุกคนที่เดินทางมาถึงจุดนี้ครับ! ตอนนี้น้องๆ มีฐานความรู้ที่แข็งแกร่งพอที่จะคุยกับทีมวิศวกร AI ระดับโลกได้อย่างเข้าใจแล้ว

และเพื่อยกระดับทักษะของเราให้กลายเป็น “ผู้เชี่ยวชาญ (Expert)” อย่างแท้จริง ใน Phase 2: เจาะลึกกลไกและสถาปัตยกรรม (Deep Dive into Mechanisms & Architectures) พี่จะพาน้องๆ ไปพบกับ:

- คณิตศาสตร์เบื้องหลังการเรียนรู้ (Gradient Descent & Backpropagation)

- ผ่าตัดสมอง Convolutional Neural Network (CNN) แบบทีละเลเยอร์

- เจาะลึกสถาปัตยกรรมระดับตำนาน (AlexNet, VGG, ResNet, Inception)

- การทำงานของโมเดลสายซิ่ง Object Detection (ตระกูล YOLO, SSD, Faster R-CNN)

เตรียมสมุดจดและเปิดสมองซีกซ้ายรอรับสมการคณิตศาสตร์ที่สนุกและเห็นภาพที่สุดในชีวิตได้เลยครับ แล้วพบกันในบทแรกของ Phase 2 ครับ!

ต้องการที่ปรึกษาด้านการพัฒนาระบบ AI Camera หรือ Machine Vision ให้กับโรงงานของคุณ? ทีมงาน WP Solution พร้อมให้บริการออกแบบและติดตั้งระบบแบบครบวงจร ดูรายละเอียดบริการของเราได้ที่: www.wpsolution2017.com หรือพูดคุยปรึกษาเบื้องต้นได้ที่ Line: wisit.p