ทะลวงขีดจำกัด Bounding Box! เจาะลึก Image Segmentation การมองเห็นระดับพิกเซล

1. 🎯 ตอนที่ 10: ทะลวงขีดจำกัด Bounding Box! เจาะลึก Image Segmentation

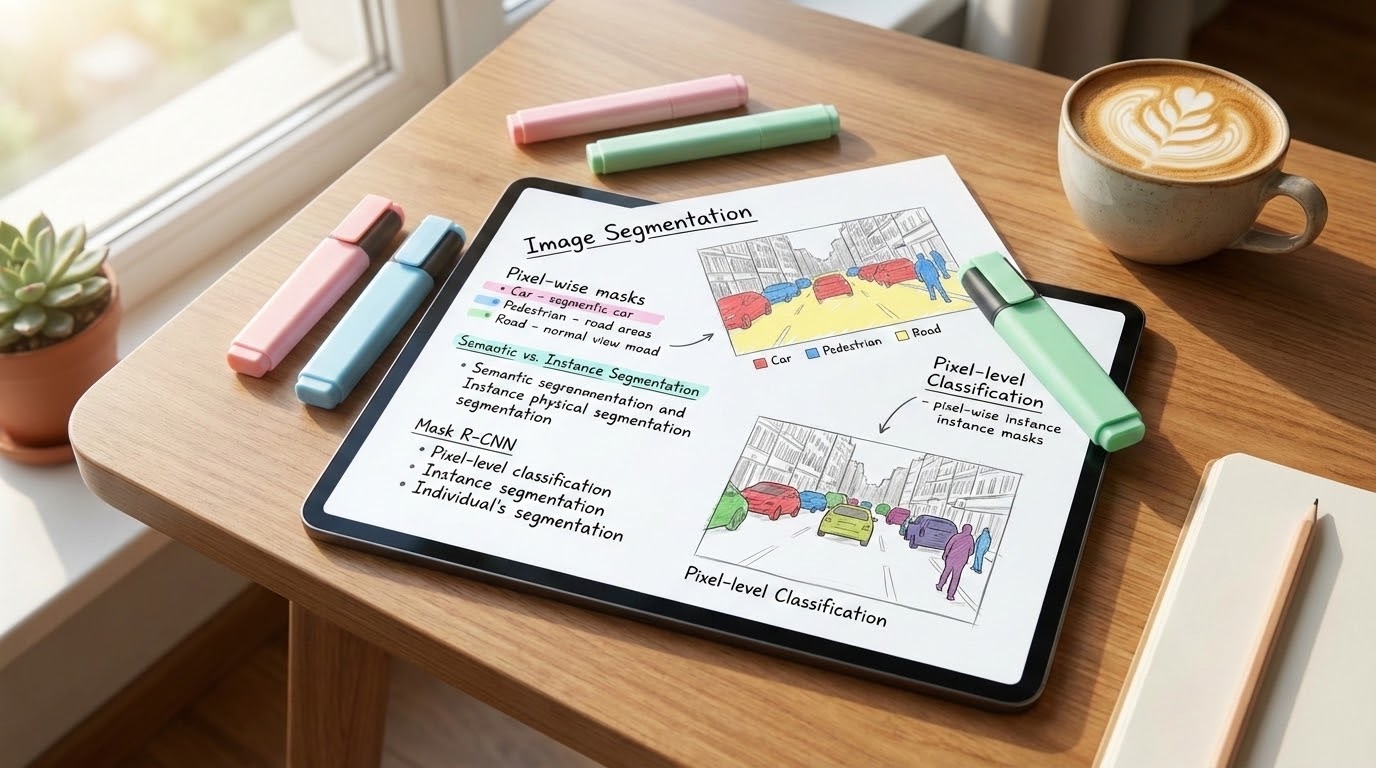

สวัสดีครับน้องๆ วิศวกรสาย Vision และนักพัฒนา AI ทุกท่าน! กาแฟแก้วโปรดในมือพร้อมแล้วใช่ไหมครับ มาลุยกันต่อเลย!

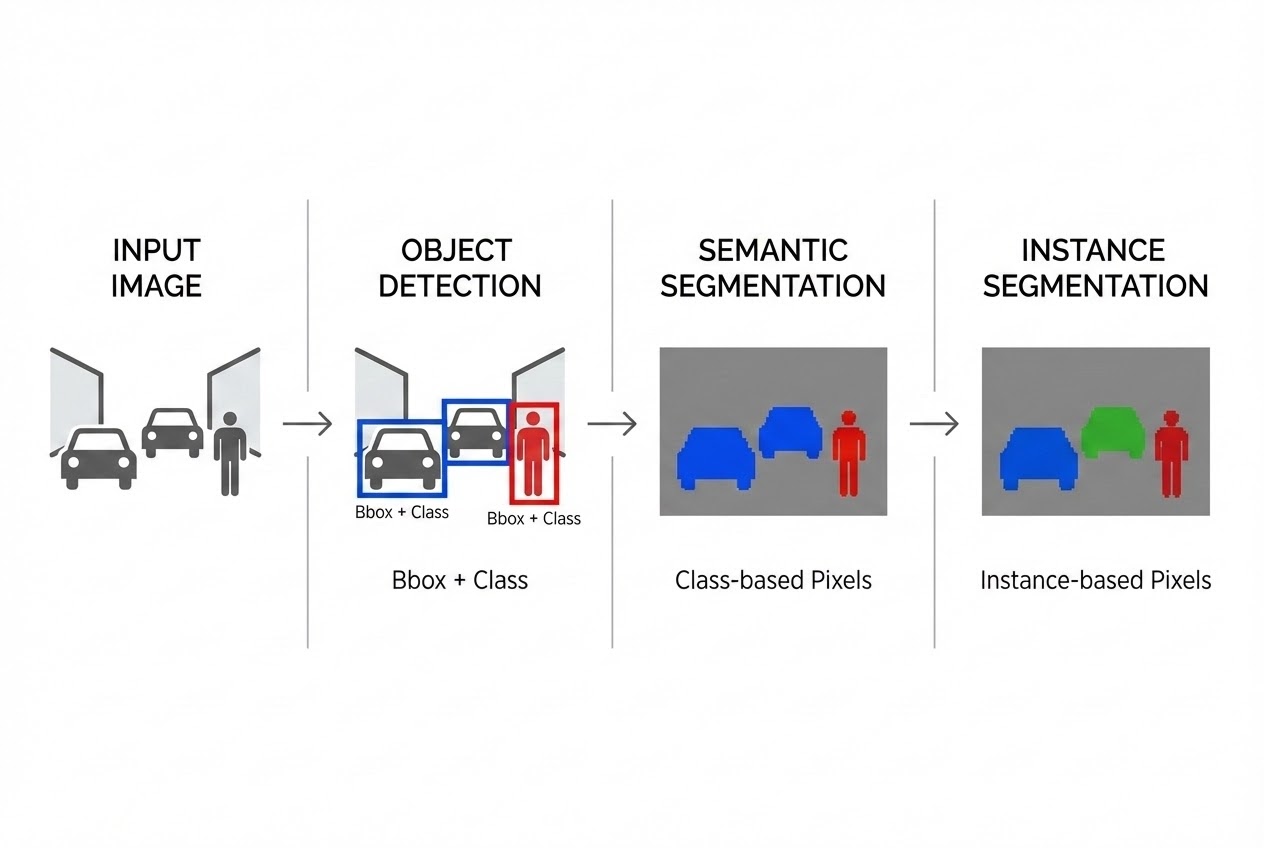

ในตอนที่แล้ว พี่พาน้องๆ ไปรู้จักกับ Object Detection ที่ AI สามารถตีกรอบสี่เหลี่ยม (Bounding Box) ล้อมรอบวัตถุเพื่อบอกพิกัดได้แล้ว แต่ในโลกการทำงานจริง… น้องๆ คิดว่ากรอบสี่เหลี่ยมมันตอบโจทย์ทุกอย่างไหมครับ?

สมมติว่าน้องกำลังทำระบบ AI วิเคราะห์ภาพถ่ายทางการแพทย์เพื่อหา “เนื้องอก (Tumor)” หรือระบบให้หุ่นยนต์หยิบจับชิ้นงานที่มีรูปทรงคดเคี้ยว การใช้ Bounding Box สี่เหลี่ยมทื่อๆ มันจะครอบเอา “พื้นหลัง (Background)” หรือเนื้อเยื่อปกติเข้ามาด้วยเสมอครับ! วันนี้พี่จะพาน้องๆ ก้าวข้ามความหยาบของกรอบสี่เหลี่ยม ไปสู่ศาสตร์ที่ลึกซึ้งที่สุดของการมองเห็น นั่นคือ Image Segmentation ที่จะสอนให้ AI แยกแยะวัตถุแบบ “พิกเซลต่อพิกเซล” กันเลยครับ!

2. 📖 เปิดฉาก (The Hook)

ลองจินตนาการถึงระบบ AI สำหรับรถยนต์ไร้คนขับ (Autonomous Driving) ดูนะครับ ถ้ารถยนต์ขับไปเจอ “คนเดินข้ามถนน” แล้ว AI ตีกรอบ Bounding Box สี่เหลี่ยมล้อมรอบคนๆ นั้น… ปัญหาคือ ภายในกรอบสี่เหลี่ยมนั้น ไม่ได้มีแค่ร่างกายของคนครับ แต่มันรวมเอา “พื้นถนน” หรือ “รถคันข้างๆ” ที่แทรกอยู่ในช่องว่างของกรอบเข้ามาด้วย

ถ้ารถยนต์คำนวณระยะเบรกจากขอบเขตของ Bounding Box มันอาจจะเบรกหัวทิ่มทั้งๆ ที่ยังไม่ชน หรือกะระยะวงเลี้ยวผิดพลาด! นี่คือความเจ็บปวดที่วิศวกรต้องเจอครับ เราต้องการความแม่นยำระดับรูปร่างที่แท้จริง ไม่ใช่แค่กล่องหยาบๆ

เทคโนโลยี Image Segmentation จึงถือกำเนิดขึ้นมาเพื่อเปลี่ยนกระบวนทัศน์นี้ โดยเปลี่ยนจากการถามว่า “วัตถุอยู่ในกล่องพิกัดไหน?” ไปเป็นการถามว่า “พิกเซลแต่ละจุดบนหน้าจอ เป็นของวัตถุอะไร?” ซึ่งให้ความละเอียดระดับสูงสุดที่คอมพิวเตอร์จะทำได้ครับ!

3. 🧠 แก่นวิชา (Core Concepts)

ในโลกของการแบ่งส่วนภาพ (Image Segmentation) แหล่งข้อมูลระดับโลกได้แบ่งกระบวนการนี้ออกเป็น 2 สายหลักๆ ที่ทำงานต่างกันอย่างสิ้นเชิงครับ:

- 1. Semantic Segmentation (เหมาเข่งตามคลาส):

- งานนี้คือการจำแนกประเภท (Classify) ให้กับ “ทุกๆ พิกเซล (Pixel-wise classification)” ในภาพ

- จุดเด่น: ระบบจะระบายสีพิกเซลตามหมวดหมู่ (Class) เช่น ถ้าเจอรถยนต์ก็ระบายสีแดง เจอถนนระบายสีเทา

- ข้อจำกัด: มันไม่สามารถแยกแยะวัตถุที่เป็น “คลาสเดียวกัน” ได้ครับ! เช่น ถ้าน้องมีรถจักรยานจอดซ้อนกัน 10 คัน ในสายตาของ Semantic Segmentation มันจะมองเห็นเป็น “ก้อนพิกเซลรถจักรยานก้อนยักษ์ๆ 1 ก้อน (One big lump of pixels)” โดยไม่รู้เลยว่าคันไหนเป็นคันไหน

- 2. Instance Segmentation (แยกแยะรายบุคคล):

- นี่คือร่างสุดยอดที่เกิดจากการฟิวชัน (Combination) ระหว่าง Object Detection และ Semantic Segmentation เข้าด้วยกัน!

- การทำงาน: มันจะหาวัตถุก่อน (เหมือน Detection) จากนั้นค่อยระบายสีพิกเซลเฉพาะส่วนที่เป็นวัตถุจริงๆ (เหมือน Segmentation)

- จุดเด่น: มันสามารถแยกวัตถุคลาสเดียวกันออกจากกันได้ครับ! แมวตัวที่ 1 จะถูกระบายด้วยสีเหลือง ส่วนแมวตัวที่ 2 จะถูกระบายด้วยสีแดง ทำให้เราสามารถนับจำนวนและดูรูปร่างของแต่ละชิ้นได้อย่างแม่นยำ

4. 💻 ร่ายมนต์โค้ด (Show me the Code)

ในแง่ของโครงสร้างข้อมูล (Data Structure) ตอนเขียนโค้ด น้องๆ ทราบไหมครับว่า Output ของโมเดล Semantic Segmentation หน้าตาเป็นอย่างไร? ลองดูแนวคิดนี้ผ่าน Python/TensorFlow ครับ:

import numpy as np

# -------------------------------------------------------------

# 📌 1. โครงสร้างข้อมูลของ Semantic Segmentation

# -------------------------------------------------------------

# สมมติว่าภาพ Input (RGB) มีขนาด 224 x 224 พิกเซล x 3 แชนเนล

input_image_shape = (224, 224, 3)

# Output ของโมเดล Semantic Segmentation จะยังคงรักษาความกว้างxยาวไว้!

# แต่มิติสุดท้าย จะกลายเป็น "จำนวนคลาส" แทน (เช่น 21 คลาส)

output_shape = (224, 224, 21)

# อ้างอิงจากโมเดลในตำรา: แต่ละพิกเซลจะมีค่าความน่าจะเป็น 21 ค่า

# -------------------------------------------------------------

# 📌 2. การสร้าง Mask ผลลัพธ์

# -------------------------------------------------------------

# สมมติเราได้ผลลัพธ์ predictions มาจากโมเดล (shape = 224x224x21)

# predictions = model.predict(image)

# เราจะใช้คำสั่ง argmax เพื่อหาว่า "ในแต่ละพิกเซล" คลาสไหนมีคะแนนสูงสุด

# segmentation_mask = np.argmax(predictions, axis=-1)

# ตอนนี้ segmentation_mask จะมีขนาดแค่ (224, 224)

# โดยแต่ละจุดพิกเซล จะเก็บเป็นตัวเลข ID ของคลาส (เช่น 0=ถนน, 1=รถ, 2=คน)

# print(segmentation_mask.shape) --> (224, 224)

# หุ่นยนต์สามารถดึงพิกัดเฉพาะตัวเลข ID ที่ต้องการไปใช้งานได้ทันที!คอมเมนต์: ความท้าทายของการเขียนโค้ด Segmentation คือการออกแบบสถาปัตยกรรม (Architecture) ที่ต้องทำให้ Output มีขนาด Width x Height เท่ากับรูปต้นฉบับครับ ซึ่งมันกินหน่วยความจำ (RAM/VRAM) การ์ดจอโหดกว่าการทำ Classification ธรรมดามหาศาล!

5. 🛡️ เคล็ดลับจากคัมภีร์ลับ (Under the Hood / Pro-Tips)

ในการออกแบบระบบ Image Segmentation หน้างานจริง พี่มีเคล็ดลับระดับโปรมาฝากครับ:

- ระวังหายนะจากการสูญเสียความละเอียด (Loss of Spatial Resolution): เวลาที่ภาพวิ่งผ่านชั้น Convolution และ Pooling ใน CNN ขนาดของภาพจะถูกย่อให้เล็กลงเรื่อยๆ (เพื่อสกัดฟีเจอร์) ทำให้โมเดลรู้ว่า “มีคนอยู่มุมซ้ายล่าง” แต่มันลืมไปแล้วว่าพิกเซลขอบเขตคนอยู่ตรงไหนเป๊ะๆ!

- ฮีโร่ที่ชื่อว่า Encoder-Decoder (อย่าง U-Net หรือ SegNet): เพื่อแก้ปัญหาภาพหดเล็กลง วิศวกรจึงออกแบบโครงข่ายแบบ “ตัว U” ครับ ฝั่งขาลง (Encoder) จะย่อภาพเพื่อดึงความหมาย ส่วนฝั่งขาขึ้น (Decoder) จะใช้ชั้น Deconvolution (หรือ Upsampling) เพื่อขยายภาพกลับมาให้เท่าขนาดเดิม โดยใช้เทคนิค “Skip Connections” ดึงข้อมูลภาพความละเอียดสูงจากฝั่งขาลง มาแปะผสมกับฝั่งขาขึ้น ทำให้วาดขอบเขตพิกเซลได้คมกริบ!

- ถ้าอยากทำ Instance Segmentation ต้องไปคบกับ Mask R-CNN: ถ้าน้องต้องการแยกวัตถุรายตัว (Instance) สถาปัตยกรรมที่โด่งดังที่สุดคือ Mask R-CNN ครับ มันถูกต่อยอดมาจาก Faster R-CNN โดยเพิ่ม “สาขาที่สาม (Third branch)” เข้าไป นอกเหนือจากการทายคลาสและตีกล่องแล้ว มันจะสร้าง Pixel mask สำหรับวัตถุในกล่องนั้นๆ ควบคู่ไปด้วย

6. 🏁 บทสรุป (To be continued…)

โดยสรุปแล้ว Image Segmentation คือขั้นกว่าของระบบ Computer Vision ที่ปฏิวัติวงการไปสู่ “การมองเห็นระดับพิกเซล”

- ถ้าต้องการวิเคราะห์พื้นที่โดยรวม เช่น ดูว่าพื้นที่ป่าไม้ในแผนที่ดาวเทียมมีกี่เปอร์เซ็นต์ เราใช้ Semantic Segmentation

- แต่ถ้าต้องการนับจำนวนและแยกแยะเซลล์เม็ดเลือด หรือแยกวัตถุชิ้นงานบนสายพาน เราต้องใช้ Instance Segmentation ครับ

มาถึงจุดนี้ เราได้รู้จักคลังอาวุธทั้งหมดของ Computer Vision แล้วนะครับ ไม่ว่าจะเป็น Classification, Detection และ Segmentation! ในบทความตอนต่อไป พี่จะพาน้องๆ ไปดูระบบสถาปัตยกรรมที่เป็นตำนานและเป็นหัวใจของการทำ Object Detection สายซิ่งอย่าง YOLO (You Only Look Once) ดูกันว่าเขาเขียนโครงข่ายอย่างไร ให้จับภาพได้เร็วระดับ Real-time แบบที่ตาคนยังมองไม่ทัน! รอติดตามได้เลยครับ!

ต้องการที่ปรึกษาและพัฒนาระบบ Automation & Machine Vision ให้กับโรงงานของคุณ? ทีมงาน WP Solution พร้อมให้บริการออกแบบและติดตั้งระบบแบบครบวงจร ดูรายละเอียดบริการของเราได้ที่: www.wpsolution2017.com หรือพูดคุยปรึกษาเบื้องต้นได้ที่ Line: wisit.p