เปิดคลังอาวุธ AI: ฮาร์ดแวร์และซอฟต์แวร์คู่ใจที่วิศวกร Computer Vision ขาดไม่ได้

1. 🎯 ตอนที่ 5: ฮาร์ดแวร์และซอฟต์แวร์เบื้องหลัง AI สายตา

สวัสดีครับน้องๆ วิศวกรสาย Vision และนักพัฒนา AI ทุกคน! ชงกาแฟแก้วโปรดแล้วมานั่งคุยกันต่อครับ

หลังจากที่เราปูพื้นฐานทฤษฎีโครงข่ายประสาทเทียมและคำศัพท์ต่างๆ ในโลกของ Deep Learning กันไปครบถ้วนแล้ว วันนี้เราจะมาเข้าสู่โหมด “เตรียมออกรบ” กันครับ

น้องๆ หลายคนอาจจะเคยลองเขียนโค้ด AI บนคอมพิวเตอร์โน้ตบุ๊กธรรมดา แล้วพบว่าตอนสั่งเทรนโมเดล (Train Model) พัดลมหมุนดังลั่นเครื่อง แถมหน้าจอขึ้นว่า “Estimated time: 48 days” (ฮา) ทำไมการสร้าง AI สายตาถึงกินพลังงานมหาศาลขนาดนั้น? แล้ววิศวกรระดับโลกเขาใช้อาวุธหรือเครื่องมืออะไรในการจัดการโมเดลใหญ่ๆ? วันนี้พี่จะพาไปเจาะลึกทั้งฝั่ง Hardware และ Software Frameworks ที่เป็นแกนสันหลังของวงการ Computer Vision กันครับ!

2. 📖 เปิดฉาก (The Hook)

ลองจินตนาการว่าการคูณเมทริกซ์ (Matrix Multiplication) ใน Deep Learning ก็เหมือนกับการให้คนมานั่งบวกเลขพร้อมๆ กันเป็นล้านๆ ชุดครับ

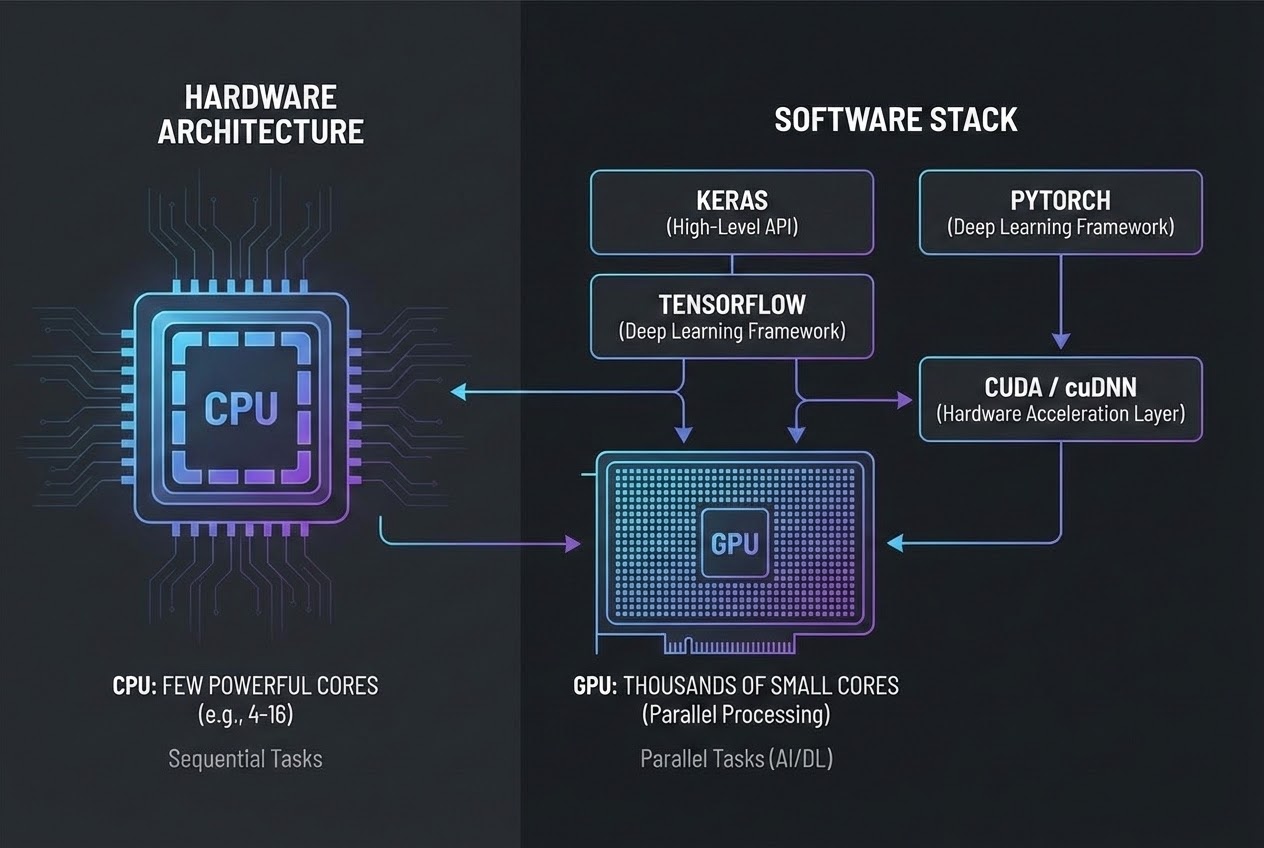

ถ้าน้องใช้ CPU (Central Processing Unit) ก็เหมือนน้องจ้าง “ศาสตราจารย์ด้านคณิตศาสตร์ระดับอัจฉริยะ” มาทำงาน… แต่จ้างมาได้แค่ 4-8 คน (Cores) พวกเขาคิดเลขยากๆ ได้เร็วมาก แต่พอเจอเลขง่ายๆ เป็นล้านๆ ชุดพร้อมกัน พวกเขาก็ทำไม่ทันครับ

นี่จึงเป็นจุดที่วงการ AI ต้องหันไปพึ่งพา GPU (Graphics Processing Unit) ซึ่งเปรียบเสมือนการจ้าง “เด็กประถมธรรมดาๆ” แต่ขนมาทีเดียว 10,000 คน! ให้ทุกคนช่วยกันคิดเลขคนละชุด ผลลัพธ์คือการประมวลผลภาพถ่ายและวิดีโอถูกเร่งความเร็วขึ้นจากที่ต้องรอเป็นเดือน เหลือเพียงแค่ไม่กี่ชั่วโมง! การปฏิวัติของฮาร์ดแวร์และซอฟต์แวร์เหล่านี้แหละครับ ที่ทำให้ AI เก่งกระโดดก้าวข้ามขีดจำกัดมนุษย์ได้อย่างทุกวันนี้

3. 🧠 แก่นวิชา (Core Concepts)

เพื่อให้น้องๆ เลือกอาวุธไปใช้ในโปรเจกต์ได้อย่างถูกต้อง พี่ขอสรุปเครื่องมือหลักๆ ที่แหล่งข้อมูลระดับโลกและวิศวกรเลือกใช้กันดังนี้ครับ:

🖥️ ฝั่ง Hardware: ทำไมต้อง NVIDIA GPU?

ในวงการ Deep Learning และ Machine Vision ปัจจุบัน การ์ดจอจากค่ายค่ายเขียว NVIDIA ถือเป็นผู้ผูกขาดตลาดอย่างแท้จริงครับ เหตุผลไม่ใช่แค่เรื่องความแรงของชิป (Hardware) แต่เป็นเรื่องของซอฟต์แวร์สนับสนุนเบื้องหลัง:

- CUDA (Compute Unified Device Architecture): นี่คือเทคโนโลยีที่อนุญาตให้นักพัฒนาสามารถเขียนโค้ดเพื่อเข้าถึงคอร์ประมวลผลนับพันของ GPU เพื่อทำงานคำนวณทั่วไปได้ (ไม่ใช่แค่เรนเดอร์ภาพกราฟิก)

- cuDNN (CUDA Deep Neural Network library): นี่คือทีเด็ดครับ! มันคือไลบรารีที่ NVIDIA ปรับแต่งมาเป็นพิเศษ (Optimized) สำหรับการคำนวณใน Deep Learning เช่น การทำ Convolution, Pooling และ Activation functions ทำให้การเทรนโมเดลเร็วขึ้นแบบก้าวกระโดด

💻 ฝั่ง Software: 3 ทหารเสือแห่งวงการ Frameworks

ในอดีต การเขียนโค้ด AI น้องต้องเขียนสมการ Backpropagation เองทั้งหมด (แค่คิดก็ปวดหัวแล้ว) แต่ปัจจุบันเรามี Deep Learning Frameworks ที่คอยจัดการคณิตศาสตร์ยากๆ ให้เราครับ:

- 1. TensorFlow (โดย Google): พี่ใหญ่แห่งวงการที่ออกแบบมาเพื่อการทำงานสเกลใหญ่ (Large-scale) รองรับการทำ Distributed Computing (เทรนพร้อมกันหลายๆ เครื่อง) และมาพร้อมเครื่องมือสุดโหดอย่าง TensorBoard ที่ใช้สร้างกราฟดูความแม่นยำ (Loss/Accuracy) แบบเรียลไทม์ และ TensorFlow Serving สำหรับนำโมเดลขึ้น Production บน Server จริง

- 2. Keras (Friendly Interface):

สร้างโดยคุณ François Chollet มันคือ Framework ระดับสูง (High-level API) ที่ครอบทับอยู่บน TensorFlow อีกที Keras ออกแบบมาให้ “มนุษย์” ใช้งานง่ายที่สุด (User-friendly) เปรียบเหมือนตัวต่อ Lego ที่น้องสามารถเรียก

layers.Conv2Dหรือlayers.Denseมาต่อๆ กันเป็นโมเดลได้ในโค้ดไม่กี่บรรทัด ปัจจุบัน Keras ถูกรวมเป็นส่วนหนึ่งของ TensorFlow ไปแล้ว (ใช้งานผ่านtf.keras) - 3. PyTorch (โดย Facebook/Meta): คู่แข่งตัวฉกาจที่นักวิจัย (Researchers) รักมากที่สุด! จุดเด่นของ PyTorch คือการสร้างกราฟคำนวณแบบ Dynamic Computation Graph (Eager Execution) แปลว่าน้องสามารถรันโค้ดและ Debug ดูค่าตัวแปรได้ทีละบรรทัดเหมือนเขียน Python ปกติ ทำให้มันยืดหยุ่นและปรับแต่งสถาปัตยกรรมแปลกๆ ได้ง่ายมาก

4. 💻 ร่ายมนต์โค้ด (Show me the Code)

ก่อนที่จะเริ่มสร้างโมเดล สิ่งแรกที่วิศวกร AI ต้องทำคือ “การเช็กว่าโปรแกรมของเรามองเห็น GPU หรือไม่” เพื่อไม่ให้โค้ดแอบไปรันบน CPU จนเครื่องค้าง ลองดูโค้ดการเช็กฮาร์ดแวร์ของทั้ง 2 ค่ายกันครับ:

ตัวอย่างใน TensorFlow / Keras:

import tensorflow as tf

# 1. เช็กรายการ GPU ทั้งหมดที่ TensorFlow มองเห็น

physical_devices = tf.config.list_physical_devices('GPU')

print("จำนวน GPU ที่ใช้งานได้:", len(physical_devices))

if len(physical_devices) > 0:

# พิมพ์ชื่อรุ่นของ GPU ออกมาดู

print("รายละเอียด GPU:", tf.config.experimental.get_device_details(physical_devices))

else:

print("แย่แล้ว! โค้ดกำลังจะรันบน CPU เครื่องพังแน่ๆ")ตัวอย่างใน PyTorch:

import torch

# 1. เช็กว่า CUDA (NVIDIA GPU) พร้อมใช้งานหรือไม่

if torch.cuda.is_available():

device = torch.device("cuda")

print(f"เชื่อมต่อ GPU สำเร็จ! รุ่น: {torch.cuda.get_device_name(0)}")

else:

device = torch.device("cpu")

print("ใช้งานได้แค่ CPU เท่านั้น")

# เวลาใช้งานจริง เราจะย้ายตัวแปรหรือโมเดลไปที่ GPU ด้วยคำสั่ง .to(device)

# model = MyCNN().to(device)5. 🛡️ เคล็ดลับจากคัมภีร์ลับ (Under the Hood / Pro-Tips)

จากประสบการณ์หน้างานจริง พี่มีเทคนิคการเอาตัวรอดเรื่องฮาร์ดแวร์มาแชร์ครับ:

- ทางรอดของคนไม่มีงบ (Cloud is your friend): ถ้าน้องเพิ่งเริ่มเรียน ไม่จำเป็นต้องกำเงินแสนไปซื้อการ์ดจอระดับเซิร์ฟเวอร์ครับ! Google ใจดีเปิดบริการ Google Colab ให้น้องๆ เข้าไปเขียนโค้ด Python และยืม GPU มาใช้เทรนโมเดลได้ฟรีๆ (ผ่านเบราว์เซอร์เลย) หรือถ้าทำระบบจริงจัง ก็สามารถเช่า Cloud อย่าง AWS EC2 หรือ Google Cloud Platform สตาร์ทเครื่องรันเฉพาะตอนเทรน จ่ายเงินเป็นรายชั่วโมง ประหยัดกว่าซื้อขาดมากครับ

- ปีศาจร้ายที่ชื่อว่า OOM (Out of Memory): ปัญหาคลาสสิกเวลาเทรนภาพขนาดใหญ่หรือโมเดลลึกๆ คือแรมการ์ดจอ (VRAM) เต็มครับ โปรแกรมจะพังแล้วฟ้องว่า OOM Error วิธีแก้หน้างานที่ง่ายที่สุดคือการลด Batch Size (จำนวนภาพที่ป้อนให้ GPU ในแต่ละรอบ) ลง เช่น จาก 64 เหลือ 32 หรือ 16 เพื่อลดภาระหน่วยความจำครับ

- อย่าลืม OpenCV: แม้เราจะมีสุดยอด Framework อย่าง TensorFlow แต่ก่อนที่รูปภาพจะเข้าไปในโมเดล น้องต้องใช้ไลบรารีพื้นฐานอย่าง OpenCV (cv2) ในการอ่านไฟล์ภาพจากกล้องวงจรปิด ปรับสเกลภาพ ย่อขนาด หรือเปลี่ยนสีภาพเสมอ มันคือเครื่องมือทำความสะอาดวัตถุดิบ (Preprocessing) ที่ขาดไม่ได้เด็ดขาดครับ

6. 🏁 บทสรุป (To be continued…)

โดยสรุปแล้ว การทำงานด้าน Computer Vision ยุคใหม่ ไม่สามารถแยกขาดระหว่างซอฟต์แวร์และฮาร์ดแวร์ได้ครับ NVIDIA GPU (พร้อม CUDA/cuDNN) คือเครื่องยนต์ทรงพลังที่รับหน้าที่คำนวณคณิตศาสตร์มหาศาล ในขณะที่ TensorFlow, Keras, และ PyTorch คือพวงมาลัยและหน้าปัดที่ช่วยให้เราควบคุมการทำงานของเครื่องยนต์นั้นได้อย่างนุ่มนวลและเป็นมิตรกับนักพัฒนา

ตอนนี้พวกเรามีทั้งความเข้าใจเรื่อง Data, เข้าใจคณิตศาสตร์เบื้องหลัง, และมีคลังอาวุธพร้อมรบแล้ว! ในบทความตอนหน้า พี่จะพาน้องๆ เริ่มลงมือเขียนโค้ดสร้าง Image Classifier (โมเดลแยกแยะประเภทภาพ) ของจริงขึ้นมาใช้งานตั้งแต่ต้นจนจบ เตรียมเปิด Jupyter Notebook หรือ Google Colab รอไว้ได้เลยครับ งานนี้สนุกและได้เห็นผลลัพธ์เป็นชิ้นเป็นอันแน่นอน!

ต้องการที่ปรึกษาด้านการพัฒนาระบบ AI Camera หรือ Machine Vision ให้กับโรงงานของคุณ? ทีมงาน WP Solution พร้อมให้บริการออกแบบและติดตั้งระบบแบบครบวงจร ดูรายละเอียดบริการของเราได้ที่: www.wpsolution2017.com หรือพูดคุยปรึกษาเบื้องต้นได้ที่ Line: wisit.p