ไขปริศนาแดนสนธยา: เจาะลึก Hidden Layers ขุมพลังลับแห่งสถาปัตยกรรมโครงข่ายประสาท

1. 🎯 ตอนที่ 6: ไขปริศนาแดนสนธยา เมื่อ Hidden Layers คือขุมพลังลับที่แท้จริง

สวัสดีครับน้องๆ วิศวกรและนักพัฒนาทุกท่าน! วันนี้พี่จะพามาเจาะลึกส่วนที่ลึกลับที่สุด แต่น่าหลงใหลที่สุดของโลก Deep Learning กันครับ นั่นก็คือ “Hidden Layers (ชั้นซ่อน)” เวลาเราพูดถึงโครงสร้างเครือข่ายประสาท (Neural Network Architectures) ไม่ว่าจะเป็นแบบดั้งเดิมอย่าง MLP หรือพระเอกงานภาพอย่าง CNN ขุมพลังที่ทำให้ AI ของเราฉลาดล้ำลึกล้วนซ่อนตัวอยู่ที่นี่ ชงกาแฟให้พร้อม แล้วมาลุยกันเลยครับ!

2. 📖 เปิดฉาก (The Hook)

บ่อยครั้งที่ระบบ Deep Learning มักจะถูกวิจารณ์ว่าเป็นเหมือน “กล่องดำ (Black Box)” ที่ยากจะทำความเข้าใจว่ามันคิดอะไรอยู่ข้างใน ลองจินตนาการว่าโครงสร้างของ Neural Network คือ “สำนักงานนักสืบ” ครับ เวลาเรามีคดี (เช่น ภาพถ่ายชิ้นงานที่มีรอยร้าว) เราจะส่งข้อมูลผ่าน Input Layer (ชั้นรับข้อมูล) ซึ่งเปรียบเสมือนตำรวจสายตรวจที่ไปเก็บหลักฐานดิบๆ มา จากนั้นในตอนจบ Output Layer (ชั้นส่งออก) ซึ่งเปรียบเสมือนผู้บัญชาการ จะเป็นคนฟันธงว่า “ผ่าน (Pass)” หรือ “ตก (Fail)”

คำถามคือ… แล้วใครเป็นคนคิดวิเคราะห์และแกะรอยหลักฐานเหล่านั้นล่ะ? คำตอบคือเหล่านักสืบยอดฝีมือที่ทำงานอยู่หลังฉาก ซึ่งเรามองไม่เห็นกระบวนการทำงานของพวกเขาตรงๆ เราเรียกพวกเขาว่า Hidden Layers ครับ! สาเหตุที่มันถูกเรียกว่า “ชั้นซ่อน” ก็เพราะว่าในระหว่างที่โมเดลกำลังฝึกสอน (Training) เราจะไม่เห็นและไม่ได้ควบคุมข้อมูลที่วิ่งเข้าหรือวิ่งออกจากชั้นเหล่านี้เลย เราทำได้แค่ป้อนข้อมูลเข้า Input และรอรับผลลัพธ์จาก Output เท่านั้น แต่ความมหัศจรรย์ทั้งหมดในการเรียนรู้ฟีเจอร์ต่างๆ เกิดขึ้นในแดนสนธยาแห่งนี้นี่เองครับ

3. 🧠 แก่นวิชา (Core Concepts)

ในบริบทที่กว้างขึ้นของสถาปัตยกรรมเครือข่ายประสาท แหล่งข้อมูลได้อธิบายบทบาทและพฤติกรรมของ Hidden Layers ไว้ดังนี้ครับ:

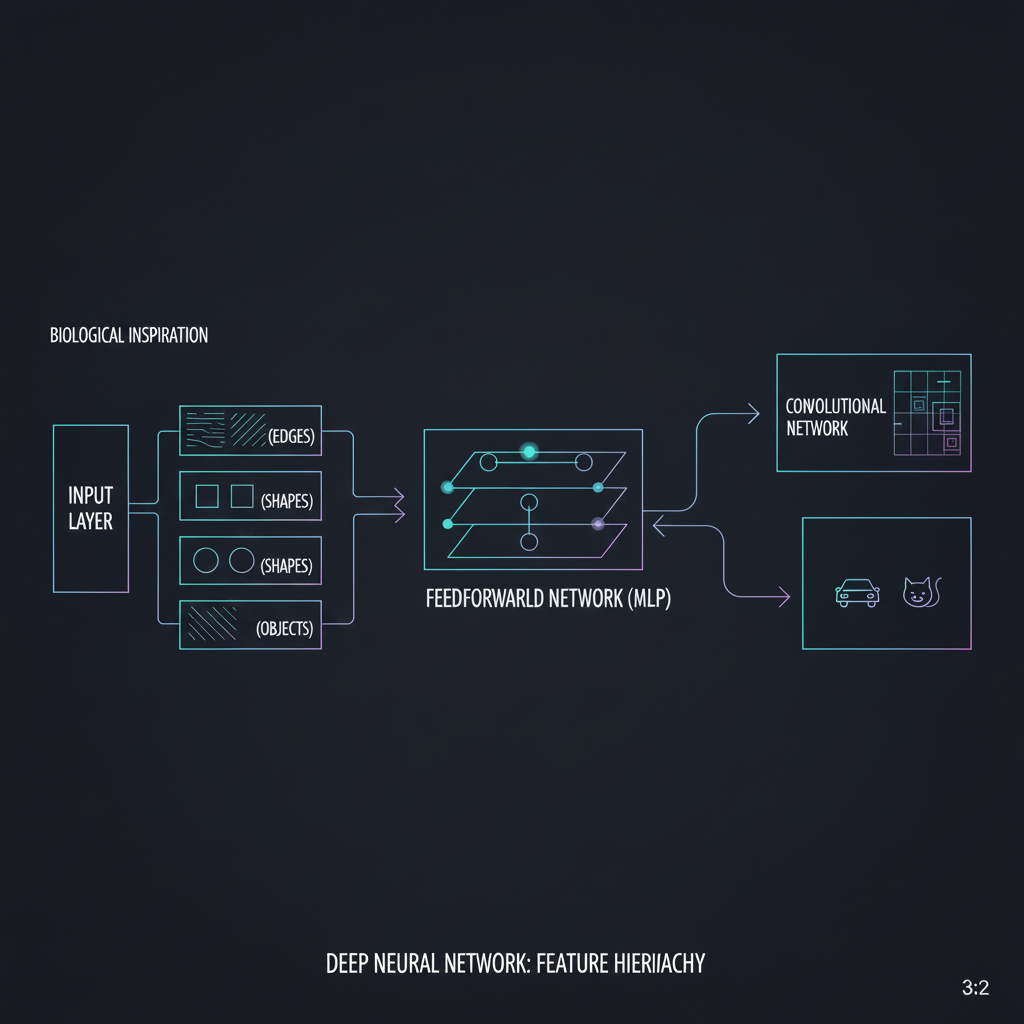

1. Hierarchical Feature Learning (การเรียนรู้คุณลักษณะแบบลำดับขั้น): นี่คือความสามารถระดับเวทมนตร์ของ Hidden Layers เลยครับ! เมื่อเรานำชั้นซ่อนเหล่านี้มาซ้อนทับกันหลายๆ ชั้น (จนกลายเป็น Deep Learning) มันจะไม่ทำงานซ้ำซ้อนกัน แต่มันจะแบ่งหน้าที่กันวิเคราะห์ข้อมูลจาก “หยาบ” ไปหา “ละเอียด”

- Hidden Layer แรกๆ (Low-level): จะสกัดจุดเด่นพื้นฐาน เช่น เส้นตรง เส้นโค้ง หรือเส้นขอบ (Edges/Blobs),,

- Hidden Layer กลางๆ (Mid-level): จะนำเส้นเหล่านั้นมาประกอบกันเป็นรูปทรง (Shapes) เช่น วงกลม มุม หรือรูปแบบที่ซ้อนทับกัน,,,

- Hidden Layer ลึกๆ (High-level): จะนำรูปทรงมาประกอบร่างเป็นวัตถุที่มีความหมายซับซ้อน เช่น ดวงตา, ใบหน้าคน, ล้อรถ หรือรอยร้าวบนชิ้นงาน,,,

2. ความจุในการเรียนรู้ (Learning Capacity): การออกแบบสถาปัตยกรรมของเครือข่ายจะถูกกำหนดโดย 2 ตัวแปรหลักของ Hidden Layers:

- ความลึก (Depth): คือจำนวนของชั้น Hidden Layers ที่เรียงต่อกัน ยิ่งมีหลายชั้น เครือข่ายยิ่งสามารถเรียนรู้ระดับความซับซ้อนแบบลำดับขั้นได้ลึกซึ้งยิ่งขึ้น,

- ความกว้าง (Width): คือจำนวนของเซลล์ประสาท (Neurons/Hidden units) ในแต่ละชั้น จำนวนที่มากขึ้นหมายถึงความจุในการจดจำรูปแบบข้อมูลที่มากขึ้น ซึ่งหากใส่น้อยไปโมเดลอาจจะ Underfit แต่ถ้าใส่มากไปก็เสี่ยงที่จะ Overfit ได้ครับ

3. รูปแบบของ Hidden Layers ในแต่ละสถาปัตยกรรม: คำว่า Hidden Layers ไม่ได้จำกัดอยู่แค่รูปแบบเดียว แต่มันปรับเปลี่ยนไปตามสถาปัตยกรรมหลักของโมเดล:

- ใน MLP (Multilayer Perceptron): Hidden Layers จะเป็นแบบ Fully Connected (Dense Layer) คือทุกโหนดเชื่อมต่อกันหมด,

- ใน CNN (Convolutional Neural Network): ชั้น Convolutional Layers ถือเป็น Hidden Layers เช่นกัน โดยเราจะเพิ่มจำนวนโหนดในชั้นนี้ผ่านการเพิ่ม “จำนวนฟิลเตอร์ (Kernels)”,

- ใน RNN (Recurrent Neural Network): ชั้น Recurrent ทำหน้าที่เป็น Hidden Layers (มักแทนด้วยสัญลักษณ์ $h$) ที่ช่วยเก็บสถานะข้อมูลที่อ้างอิงกับเวลาในอดีต (Time sequence),

4. 💻 ร่ายมนต์โค้ด (Show me the Code)

เพื่อให้เห็นภาพว่า การสร้าง Hidden Layers แบบดั้งเดิม (Dense) เทียบกับแบบงานภาพ (Conv2D) ในโค้ดของ Keras/TensorFlow หน้าตาเป็นอย่างไร ลองดูตัวอย่างนี้ครับ:

import tensorflow as tf

from tensorflow import keras

from tensorflow.keras import layers

# -------------------------------------------------------------

# แบบที่ 1: Hidden Layers สำหรับ MLP (เหมาะกับข้อมูลตัวเลข 1 มิติ)

# -------------------------------------------------------------

mlp_model = keras.Sequential([

layers.Flatten(input_shape=(28, 28)), # Input Layer

# 📌 นี่คือ Hidden Layer ชั้นที่ 1 (กว้าง 512 โหนด)

# เลือกใช้ ReLU เป็น Activation Function เพื่อเพิ่ม Non-linearity

layers.Dense(512, activation='relu', name="Hidden_Dense_1"),

# 📌 นี่คือ Hidden Layer ชั้นที่ 2 (เพิ่มความลึก เพื่อเรียนรู้ที่ซับซ้อนขึ้น)

layers.Dense(512, activation='relu', name="Hidden_Dense_2"),

layers.Dense(10, activation='softmax') # Output Layer

])

# -------------------------------------------------------------

# แบบที่ 2: Hidden Layers สำหรับ CNN (พระเอกของงาน Machine Vision!)

# -------------------------------------------------------------

cnn_model = keras.Sequential([

layers.InputLayer(input_shape=(224, 224, 3)),

# 📌 Hidden Layer 1: ใช้ Conv2D มองหาเส้นขอบ (Low-level features)

# จำนวน 64 filters คือการเพิ่มจำนวน Neurons (ความกว้าง) ให้ชั้นนี้นั่นเอง

layers.Conv2D(filters=64, kernel_size=(3, 3), activation='relu', name="Hidden_Conv_1"),

layers.MaxPooling2D(pool_size=(2, 2)),

# 📌 Hidden Layer 2: มองหารูปทรง (Mid-level features)

layers.Conv2D(filters=128, kernel_size=(3, 3), activation='relu', name="Hidden_Conv_2"),

layers.MaxPooling2D(pool_size=(2, 2)),

layers.Flatten(),

layers.Dense(10, activation='softmax') # Output Layer

])คอมเมนต์: สังเกตว่าใน Keras การใส่ Hidden Layer เราใช้การซ้อนบล็อกโค้ดง่ายๆ เลยครับ และเราจำเป็นต้องใส่ Activation Function (เช่น ReLU) ให้กับทุกๆ Hidden Layer เพราะถ้าไม่ใส่ นิวรอนจะส่งผ่านข้อมูลแบบเชิงเส้นธรรมดา ทำให้ไม่สามารถแก้ปัญหาที่ซับซ้อนในโลกจริงได้ครับ

5. 🛡️ เคล็ดลับจากคัมภีร์ลับ (Under the Hood / Pro-Tips)

ในฐานะวิศวกรที่ต้องจูนโมเดลหน้างานจริง พี่มีคำเตือนเกี่ยวกับ Hidden Layers มาฝากครับ:

- ระวังอาการจำข้อสอบ (Overfitting): ถ้าเราใส่ Hidden Layers จำนวนมากให้มันมีความจุ (Capacity) สูงปรี๊ด แต่มีชุดข้อมูล (Dataset) ให้เรียนรู้นิดเดียว โมเดลของเราจะท่องจำทุกพิกเซลของรูปในชุดฝึกสอนได้ 100% (Overfit) แต่พอไปเจอภาพใหม่หน้างานจริงกลับทายผิดหมด วิธีแก้คือต้องใช้เทคนิคอย่างการทำ Data Augmentation หรือการใส่ Dropout layers ครับ,

- คำสาปของความลึก (Vanishing Gradients): เมื่อเราทำให้ Hidden Layers มีความ “ลึก (Deep)” มากๆ จะเกิดปัญหาที่เรียกว่า Vanishing Gradients ครับ นั่นคือระหว่างกระบวนการย้อนกลับ (Backpropagation) สัญญาณความผิดพลาด (Error) ที่ใช้ปรับค่าน้ำหนัก จะถูกคูณไปเรื่อยๆ จนมีค่าหดเล็กลงเข้าใกล้ศูนย์ ทำให้ Hidden Layers ในชั้นแรกๆ ไม่เกิดการเรียนรู้เลย!

- ทางรอด: ปัญหานี้แก้ได้โดยการทิ้ง Activation Function แบบเดิม (อย่าง Sigmoid หรือ Tanh ที่ค่ามันอิ่มตัวง่าย) แล้วหันมาใช้ ReLU (Rectified Linear Unit) เป็นค่าเริ่มต้นสำหรับ Hidden Layers,, รวมถึงการแทรกชั้น Batch Normalization เข้าไปเพื่อปรับความเสถียรของการกระจายข้อมูลในระหว่าง Hidden Layers ครับ

6. 🏁 บทสรุป (To be continued…)

สรุปได้ว่า Hidden Layers คือ “สมองส่วนคิดวิเคราะห์” ที่แท้จริงของเครือข่ายประสาทครับ มันคือพื้นที่ที่ปัญญาประดิษฐ์ทำการสกัดจุดเด่น สร้างลำดับขั้นทางความคิด (Hierarchical) จากเส้นตรงธรรมดาๆ จนกลายเป็นการรับรู้วัตถุระดับซับซ้อน โดยที่สถาปัตยกรรมเครือข่ายจะเก่งแค่ไหน ก็ขึ้นอยู่กับความลึกและความกว้างที่เรากำหนดให้แดนสนธยาแห่งนี้นั่นเอง

เมื่อเราเข้าใจธรรมชาติของ “ชั้นซ่อน” แล้ว ในบทความต่อไป พี่จะพาน้องๆ ไปสวมวิญญาณมือปราบ พบกับฮีโร่ตัวจริงของวงการ Machine Vision ที่ชื่อว่า Convolutional Neural Networks (CNNs) ซึ่งเกิดมาเพื่อจัดการกับรูปภาพโดยเฉพาะ ห้ามพลาดเด็ดขาดครับ!

ต้องการที่ปรึกษาและพัฒนาระบบ Automation & Machine Vision ให้กับโรงงานของคุณ? ทีมงาน WP Solution พร้อมให้บริการออกแบบและติดตั้งระบบแบบครบวงจร ดูรายละเอียดบริการของเราได้ที่: www.wpsolution2017.com หรือพูดคุยปรึกษาเบื้องต้นได้ที่ Line: wisit.p