ผ่าสมองกลจักรกล: เจาะลึกโครงสร้างเครือข่ายประสาท (Network Architectures) ในโลก Deep Learning

1. 🎯 ตอนที่ 3: ผ่าสมองกลจักรกล เจาะลึกโครงสร้างเครือข่ายประสาท (Network Architectures)

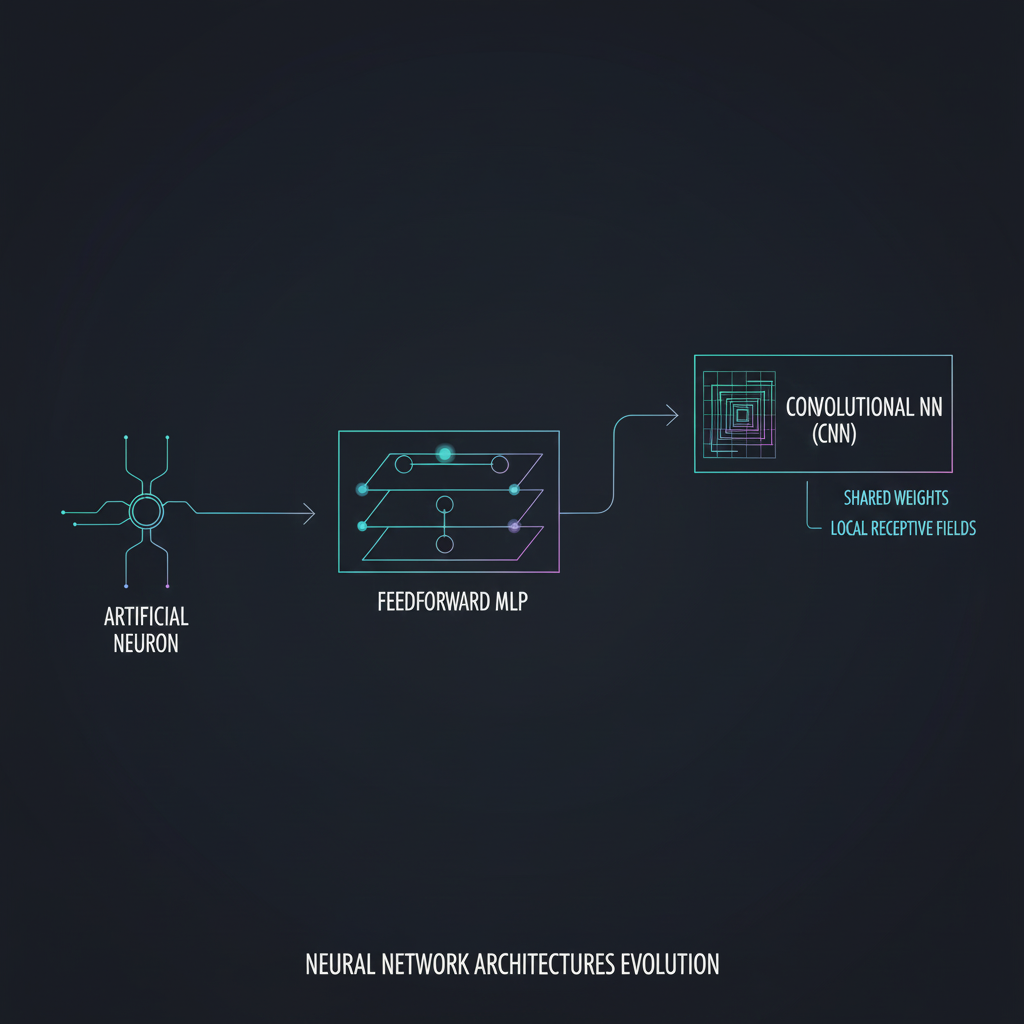

สวัสดีครับน้องๆ วิศวกรและนักพัฒนาทุกคน! ชงกาแฟให้พร้อมแล้วมาล้อมวงกันตรงนี้ครับ วันนี้พี่จะพาถอยหลังกลับมามองภาพใหญ่กันอีกนิด เพื่อทำความเข้าใจ “สถาปัตยกรรม (Architectures)” ที่เป็นโครงสร้างพื้นฐานของ Deep Learning เราจะมาดูกันว่าจากเซลล์ประสาทเทียมโง่ๆ เพียงเซลล์เดียว มันประกอบร่างกันอย่างไรจนกลายเป็นสมองกลที่สามารถแยกแยะใบหน้าคน หรือตรวจจับรอยร้าวบนชิ้นงานในโรงงานอุตสาหกรรมของเราได้!

2. 📖 เปิดฉาก (The Hook)

ลองจินตนาการว่าเรากำลังสร้างระบบ AI ให้กับหุ่นยนต์ในโรงงาน ถ้าเราให้วิศวกรฝึกหัดแค่คนเดียว (เซลล์ประสาทเดียว) ไปดูชิ้นงาน เขาอาจจะตอบได้แค่คำถามง่ายๆ เช่น “งานชิ้นนี้สว่างหรือมืด?” แต่ถ้าเราต้องการให้เขาระบุว่า “ชิ้นงานนี้มีรอยขีดข่วนที่มุมซ้ายล่างหรือไม่?” วิศวกรคนเดียวคงเอาไม่อยู่ครับ เราจำเป็นต้องสร้าง “องค์กร” หรือ “เครือข่าย” ของวิศวกรนับล้านคนมาช่วยกันทำงาน

แนวคิดนี้เองครับที่จุดประกายให้เกิด Artificial Neural Networks (ANNs) หรือเครือข่ายประสาทเทียม ซึ่งเป็นศาสตร์ที่ได้รับแรงบันดาลใจมาจากเครือข่ายเซลล์ประสาททางชีววิทยา (Biological Neural Networks) ในสมองของมนุษย์และสัตว์ แม้ว่าในปัจจุบันนักวิจัยหลายคนจะบอกว่าเราไม่ควรยึดติดกับการเปรียบเทียบกับสมองมากเกินไป (เพราะ AI ไม่ได้ทำงานเหมือนสมองมนุษย์เป๊ะๆ 100%) แต่มันก็เป็นจุดเริ่มต้นที่ทำให้เราสร้างสถาปัตยกรรมที่ทรงพลังที่สุดในยุคนี้ได้สำเร็จครับ

3. 🧠 แก่นวิชา (Core Concepts)

ในบริบทของพื้นฐาน Deep Learning แหล่งข้อมูลระดับโลกได้แบ่งโครงสร้างเครือข่าย (Network Architectures) ออกเป็นส่วนประกอบและรูปแบบหลักๆ ดังนี้ครับ:

1. จุดกำเนิด: Artificial Neuron และ Perceptron เซลล์ประสาทชีวภาพประกอบด้วยตัวเซลล์ (Cell body), ส่วนรับสัญญาณ (Dendrites), และส่วนส่งสัญญาณ (Axon) โมเดลจำลองของมันที่เรียกว่า Artificial Neuron หรือ Perceptron ก็ทำงานคล้ายกันครับ คือรับสัญญาณ Input เข้ามา คูณด้วยค่าน้ำหนัก (Weights) บวกค่า Bias และส่งผ่านฟังก์ชันกระตุ้น (Activation Function) เพื่อตัดสินใจว่าจะยิงสัญญาณ (Fire) ออกไปหรือไม่

2. กองทัพสมองกล: Fully Connected Feedforward Network (MLP) เมื่อเซลล์เดียวไม่พอ เราจึงนำมันมาเรียงต่อกันเป็นชั้นๆ (Layers) ประกอบด้วย Input Layer, Hidden Layers (ชั้นซ่อน), และ Output Layer สถาปัตยกรรมนี้เรียกว่า Multilayer Perceptron (MLP) หรือ Feedforward Network เพราะสัญญาณจะไหลไปข้างหน้าทิศทางเดียวโดยไม่มีการย้อนกลับ (Directed Acyclic Graph)

- คำว่า “Deep” มาจากไหน? คำว่า Deep Learning ก็มาจากการที่เรามี Hidden Layers ซ้อนกันอยู่เป็นจำนวนมากนั่นเองครับ (Deep stack of hidden layers)

- Hierarchical Learning: โครงสร้างแบบลึกนี้ทำให้เกิดการเรียนรู้เป็นลำดับขั้น เลเยอร์แรกๆ จะเรียนรู้โครงสร้างระดับต่ำ (เช่น เส้นขอบ), เลเยอร์กลางๆ นำเส้นขอบมาประกอบเป็นรูปทรง, และเลเยอร์ท้ายๆ นำรูปทรงมาประกอบเป็นวัตถุที่ซับซ้อน (เช่น ใบหน้า หรือชิ้นส่วนรถยนต์)

3. ผู้เชี่ยวชาญด้านภาพ: Convolutional Neural Network (CNN) สถาปัตยกรรมนี้คือ “พระเอก” ของงาน Machine Vision ครับ! ได้รับแรงบันดาลใจจากการศึกษา Visual Cortex ของแมวและลิงโดย Hubel และ Wiesel ซึ่งพบว่าเซลล์ประสาทจะตอบสนองต่อพื้นที่เล็กๆ ที่เรียกว่า Receptive Field เท่านั้น ต่างจาก MLP ที่ทุกโหนดต้องเชื่อมต่อกันหมด (Fully Connected) CNN ใช้เทคนิค Sparse Connections (การเชื่อมต่อแบบเบาบาง) และ Weight Sharing (การใช้ค่าน้ำหนักร่วมกัน) โดยใช้ “แว่นขยาย” หรือฟิลเตอร์ กวาดไปทั่วภาพ ทำให้มันรักษาโครงสร้าง 2 มิติของภาพไว้ได้ และใช้พารามิเตอร์น้อยกว่า MLP มหาศาล

4. นักเดินทางข้ามเวลา: Recurrent Neural Network (RNN) โครงสร้างนี้ต่างจาก Feedforward ตรงที่มันมี “ลูปย้อนกลับ (Backward connections / Cycles)” ครับ ทำให้เครือข่ายมีความจำ (Memory) นิยมใช้กับข้อมูลที่เป็นลำดับเวลา (Time-series) หรือภาษาธรรมชาติ (NLP)

4. 💻 ร่ายมนต์โค้ด (Show me the Code)

เพื่อให้เห็นภาพความแตกต่างระหว่างสถาปัตยกรรมแบบ MLP (Fully Connected) และ CNN (Convolutional) ลองดูการวางโครงสร้างด้วย Keras/TensorFlow กันครับ:

import tensorflow as tf

from tensorflow.keras import layers, models

# -------------------------------------------------------------

# แบบที่ 1: สถาปัตยกรรมแบบ MLP (Fully Connected Feedforward)

# เหมาะสำหรับข้อมูลตัวเลขแบบตาราง (Tabular data)

# -------------------------------------------------------------

mlp_model = models.Sequential([

# ต้องจับภาพหรือข้อมูลมายืดให้เป็นเส้นตรง 1 มิติ (Flatten)

layers.Flatten(input_shape=(28, 28)),

# โหนดทุกตัวเชื่อมต่อกันหมด (Dense)

layers.Dense(128, activation='relu'),

layers.Dense(64, activation='relu'),

layers.Dense(10, activation='softmax')

])

# -------------------------------------------------------------

# แบบที่ 2: สถาปัตยกรรมแบบ CNN (Convolutional Neural Network)

# ออกแบบมาเพื่อ "งานภาพ (Computer Vision)" โดยเฉพาะ!

# -------------------------------------------------------------

cnn_model = models.Sequential([

# ใช้ฟิลเตอร์สกัดจุดเด่นโดยไม่ต้องยืดภาพ ยังคงความเป็น 2 มิติไว้

layers.Conv2D(32, (3, 3), activation='relu', input_shape=(28, 28, 1)),

layers.MaxPooling2D((2, 2)),

layers.Conv2D(64, (3, 3), activation='relu'),

layers.MaxPooling2D((2, 2)),

# ตอนท้ายค่อยยืดข้อมูลที่สกัดฟีเจอร์มาแล้ว เพื่อส่งให้ชั้นตัดสินใจ

layers.Flatten(),

layers.Dense(64, activation='relu'),

layers.Dense(10, activation='softmax')

])5. 🛡️ เคล็ดลับจากคัมภีร์ลับ (Under the Hood / Pro-Tips)

ในฐานะคนที่ต้องลงหน้างานจริง พี่มีเรื่องที่ต้องเตือนเกี่ยวกับการเลือกใช้ Architectures เหล่านี้ครับ:

- คำสาปของ Fully Connected กับงานภาพ: ถ้าน้องๆ เอาภาพความละเอียดสูงจากกล้อง Machine Vision ไปป้อนเข้า MLP ตรงๆ มันคือหายนะเลยครับ! เพราะภาพที่มีพิกเซลเยอะๆ จะทำให้เกิดตัวแปร (Weights) นับล้านล้านตัวในชั้น Dense Layer ทำให้เครื่องคอมพิวเตอร์ทำงานหนักเกินไปและเกิดอาการ Overfitting ได้ง่ายมาก (นี่คือเหตุผลที่ CNN เกิดมาเพื่อฆ่าปัญหาเหล่านี้ด้วย Weight Sharing)

- เวทมนตร์แห่งการเรียนรู้ (Backpropagation): ไม่ว่าน้องจะเลือกสถาปัตยกรรมแบบไหน (MLP, CNN, หรือ RNN) อัลกอริทึมเบื้องหลังที่ทำให้เครือข่ายเหล่านี้ฉลาดขึ้นมาได้คือ Backpropagation ครับ มันทำหน้าที่ส่งค่าความผิดพลาด (Error) ย้อนกลับจาก Output ไปหา Input และใช้เทคนิค Gradient Descent ในการปรับปรุงค่าน้ำหนัก (Weights) ทั่วทั้งเครือข่ายให้แม่นยำขึ้น

6. 🏁 บทสรุป (To be continued…)

สรุปง่ายๆ ครับ Network Architectures ก็เหมือนกับการจัดผังองค์กรให้กับเซลล์ประสาทเทียม ถ้าจัดเป็นลำดับชั้นตรงๆ ก็คือ Feedforward (MLP), ถ้าเน้นการสกัดจุดเด่นเฉพาะพื้นที่ก็คือ CNN, และถ้าเน้นข้อมูลที่มีความต่อเนื่องของเวลาก็คือ RNN

ความเจ๋งของ Deep Learning คือความสามารถในการเรียนรู้คุณลักษณะ (Features) ต่างๆ ได้เองโดยอัตโนมัติแบบเป็นลำดับขั้น (Hierarchical) จากโครงสร้างเหล่านี้แหละครับ ในตอนต่อไป เราจะมาล้วงความลับกันว่า เราจะใช้อาวุธอย่าง Convolutional Layers เข้ามาแก้ปัญหา Computer Vision ในโรงงานอย่างเจาะลึกได้อย่างไร รอติดตามกันนะครับ!

ต้องการที่ปรึกษาและพัฒนาระบบ Automation & Machine Vision ให้กับโรงงานของคุณ? ทีมงาน WP Solution พร้อมให้บริการออกแบบและติดตั้งระบบแบบครบวงจร ดูรายละเอียดบริการของเราได้ที่: www.wpsolution2017.com หรือพูดคุยปรึกษาเบื้องต้นได้ที่ Line: wisit.p